AI“事实核查”反成误导源头

(华盛顿2日法新电)在印度与巴基斯坦为期四天的冲突中,随着错误信息的爆发,社交媒体用户转向AI聊天机器人寻求核实,然而结果遇到了更多的虚假信息,突显了它作为事实核查工具的不可靠性。

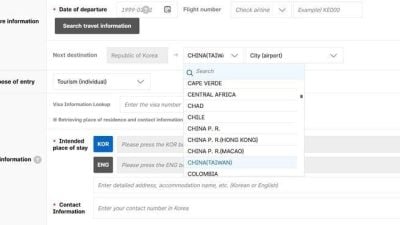

随着科技平台减少人工事实核查员,用户越来越依赖AI聊天机器人——包括xAI的Grok、OpenAI的ChatGPT和谷歌的Gemini——来寻找可靠的信息。

ADVERTISEMENT

在马斯克的AI助手X平台上,“嘿@Grok,这是真的吗?”,这已经成为一个常见的问题,反映了在社交媒体上寻求即时真相的趋势日益增长。

但这些回应本身往往充斥着错误信息。

Grok因在不相关的查询中插入极右翼阴谋论“白人种族灭绝”而再次受到审查,它错误地将苏丹喀土穆机场的旧视频片段认定为巴基斯坦最近与印度冲突期间对努尔汗空军基地的导弹袭击。

尼泊尔一座建筑物着火的无关视频,也被误认为“可能”是巴基斯坦对印度袭击的军事反应。

虚假信息监督机构NewsGuard的研究员萨德吉告诉法新社:“在X平台和其他大型科技公司缩减对人工事实核查员的投资之际,人们越来越依赖Grok作为事实核查员。”

她警告说:“我们的研究反复发现,AI聊天机器人并非可靠的新闻和信息来源,尤其是在突发新闻方面。”

NewsGuard的研究发现,10个领先的AI聊天机器人容易重复谎言,包括俄罗斯的虚假信息叙述以及与最近澳洲大选相关的虚假或误导性言论。

哥伦比亚大学 Tow 数字新闻中心最近对8个AI搜索工具进行了一项研究,发现聊天机器人“通常不擅长拒绝回答它们无法准确回答的问题,而是提供不正确或推测性的答案”。

当法新社驻乌拉圭的事实核查人员向Gemini询问一张AI生成的女性照片时,它不仅错误的确认了照片的真实性,还捏造了关于该女性身份和照片可能拍摄地点的细节。

Grok最近将一段据称是亚马逊河中一条巨型水蟒游动的视频标记为“真实”,甚至引用了听起来可信的科学考察来支持其虚假说法。

法新社驻拉丁美洲的事实核查人员报告称,实际上,该视频是AI生成的,并指出许多用户引用Grok的评估作为该视频真实存在的证据。

调查显示,网络用户正越来越多地从传统搜索引擎转向AI聊天机器人来收集和验证信息,这一发现引发了人们的担忧。

与此同时,Meta在今年早些时候宣布,将终止其在美国的第三方事实核查项目,将揭穿虚假信息的任务交给普通用户,采用一种名为“社区笔记”的功能。该功能由X平台推广。

研究人员一再质疑“社区笔记”在打击虚假信息方面的有效性。

长期以来,在极度两极化的政治气候中,人工事实核查一直是一个引爆点,尤其是在美国。保守派的倡导者认为,人工事实核查压制了言论自由,审查了右翼的内容。这是专业事实核查人员强烈反对的。

法新社目前与脸书的事实核查项目合作了26种语言,包括在亚洲、拉丁美洲和欧盟。

AI聊天机器人的质量和准确性可能会有所不同,这取决于它们的训练和编程方式,这引发了人们对它们的产出可能受到政治影响或控制的担忧。

马斯克的xAI最近指责“未经授权的修改”导致Grok生成未经请求的帖子,提到南非的“白人种族灭绝”。

当AI专家卡斯韦尔问Grok是谁修改了它的系统提示时,这个聊天机器人称马斯克是“最有可能”的罪魁祸首。

马斯克是南非出生的亿万富翁,也是特朗普的支持者。此前,他曾散布毫无根据的指控,称南非领导人“公开推动对白人的种族灭绝”。

国际事实核查网络负责人霍兰告诉法新社:“我们已看到,在人类程序员特意修改指令后,AI助手可能会捏造结果或给出带有偏见的答案。”

“我尤其担心的是,Grok在收到提供预授权答案的指令后,错误地处理了涉及非常敏感问题的请求。”

ADVERTISEMENT

热门新闻

百格视频

ADVERTISEMENT